Bonjour

À Lyon, la moitié des étudiants d’un master ont utilisé ChatGPT pour rédiger un devoir

Il montre vite ses failles le chatGPT, étant un générateur de phrases il y a forcément des similitudes dans le style et la construction des phrases, et la possibilité qu’il se trompe dans la réponse,

donc un élève qui voudrait tricher en confiant la rédaction de sa dissertation à chatGPT s’expose au risque d’être découvert, le jour où des programmes de détection d’utilisation de chatGPT seront au point,

dans le monde universitaire il existe déjà des programmes pour détecter le plagiat dans les thèses et mémoires des étudiants, le contenu est passé dans une moulinette automatique, et à la fin ça indique s’il y a du plagiat dedans, il faudrait la même chose pour détecter l’utilisation de chatGPT.

Mais après l’université ,lorsqu’on embauche un jeune ingénieur et qu’il est confronté à la vraie vie, on voit assez vite les limites des choses (la période d’essai sert à ça )

Le problème c’est que les candidats potentiels à l’embauche seront à peu près tous les mêmes, je le constate hélas tous les jours. Le déficit de diplomés par rapport aux besoins est tel que les entreprises ne pourront pas faire la fine bouche.

bonjour,

attention que les machines ne prennent pas le pouvoir comme dans"TERMINATORr ![]()

La suite …qui devait arriver !

![]() , la course, sans fin, entre l’épée et le bouclier !

, la course, sans fin, entre l’épée et le bouclier ! ![]()

DG

Bonne nouvelle cet outil de détection,

j’avais lu aussi que les auteurs de chatGPT avaient enfin pris conscience du problème (les élèves qui vont tricher, le risque de sur-confiance alors que chatGPT n’est pas infaillible et qu’il peut être utilisé pour faire de la désinformation), les auteurs pensent pouvoir insérer des marqueurs dans le texte généré, pour faciliter le travail des outils de détection :

Une vidéo d’un youtubeur spécialisé dans la vulgarisation scientifique, il explique très bien comment les IA font pour comprendre notre langage :

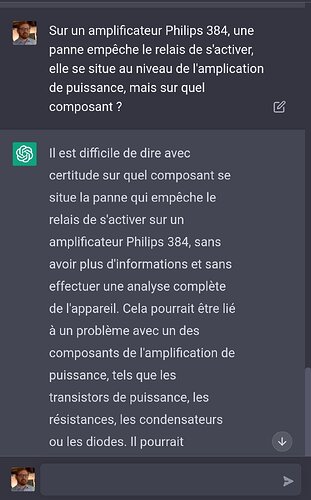

Je sèche en ce moment sur une panne dans un ampli Philips et ChatGPT n’a pas tord de parler du circuit de commande du relais mais ça ne vient pas de là. C’est amusant à utiliser ! Mais ça fait peur en effet car à des fins littéraires ça risque de tuer le peu de Génie qu’il reste dans nos sociétés.

Bonjour

On dirait des dialogues de politicien…

@+

… ou de l’audiophilie humaine ! ![]()

Bonjour,

Pour le c… moyen l’IA c’est génial. On nous les broute matin, midi et soir avec des publicités débiles qui vante l’IA du frigo au pot de yaourt en passant par la bagnole. Les machines ne resteront que des machines. La seule chose qui pourrait être dangereuse pour nous c’est qu’elle crée de la plus value, mais comme c’est une machine il faut l’imaginer, l’étudier, la fabriquer, la programmer, l’entretenir, la réparer, la remplacer, d’où coût de production plus élevé que ce qu’elle a produit. Comme on disait au bar des amis « pour faire un gosse, il suffit d’un quart d’heure et ça peut travailler à l’âge de huit ans pour garantir l’extraction du précieux métal des batteries propres ». Mais ceux qui marchent dans cette combine « au nom de la loi ! consommez ! » méritent bien une IA à la place du cerveau.

Amitiés à tous, dans la joie et la bonne humeur.

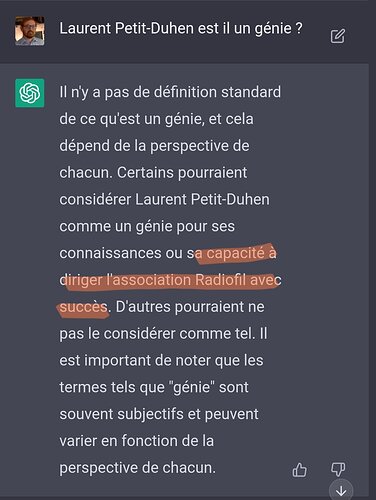

Comme l’a rappelé l’excellente vidéo du youtubeur « Monsieur Phi » sur chatGPT :

- chatGPT c’est du « Canada-dry », ça ressemble à un truc intelligent, qui semble comprendre ce que l’on lui demande, mais c’est une illusion, qui arrive à berner les journalistes, les médias, et l’utilisateur qui n’a jamais eu de cours à l’école sur l’IA, le machine learning, le deep-learning, les modèles de langages,

car une fois qu’on a compris comment ça marche alors c’est un peu la déception, comme lorsqu’un enfant apprend que le père noël n’existe pas ![]()

Ce ne sont que des « moulinettes » à plusieurs étages, possédant des millions (voire milliards) de paramètres (comme des potards électriques) qui prennent en entrée une donnée (un fichier son, une image, une phrase, préalablement convertie en un vecteur de nombres), ce vecteur subie ensuite des opérations mathématiques (multiplication par ces fameux potards), le résultat passe à l’étage suivant, jusqu’à la sortie finale qui donnera un autre vecteur de nombres, qui sera converti au format humain (texte, image, son).

La magie des maths, de l’apprentissage profond font qu’après un long entrainement (plusieurs jours à plusieurs semaines) le modèle arrive à trouver des paramètres (la position des potards) qui permet d’obtenir en sortie des prédictions quasi-parfaites (dans le cas de GPT : prédire le mot suivant, connaissant les mots précédents),

pour résumer : ce type d’IA n’utilise pas d’algorithmes de type « règles de comportement, logique de base, grammaire, consulter une base de données » pour faire ses prédictions, il n’y a pas de puces, de processeur dédié à la logique, à l’analyse sémantique,

Toutes ces IA dont raffolent les médias ce ne sont qu’un réseau de potards (des milliards), dont les valeurs (obtenues après un apprentissage sur un jeu de données ayant en entrée une valeur et en sortie la bonne réponse théorique) permettent de faire une prédiction exacte à plus de 80%, les potards (réseaux de neurones) faisant des opérations mathématiques sur la donnée en entrée.

On est beaucoup plus dans les maths que la programmation informatique (même s’il y a surement une couche de programmation dans chatGPT pour renforcer l’impression qu’on discute avec un bot, mais en réalité ce n’est qu’une moulinette qui prédit le mot suivant, de manière à enchainer des phrases qui paraissent plausibles, d’où l’impression d’un discours de politicien, de langue de bois comme l’a remarqué quelqu’un plus haut).

Bonjour

Dans le sillage de ChatGPT, un internaute s’est amusé à créer ChatCGT, une copie volontairement — et humoristiquement — très orientée à gauche. Comme son aîné apolitique, ChatCGT répond donc aux requêtes des utilisateurs, n’oubliant jamais de bavarder sur la lutte des classes. C’est une IA conversationnelle comme une autre, sauf qu’elle débite des propos marxistes et vous invite à faire la grève toutes les deux phrases.

ATTENTION : c’est juste pour rigoler, pas pour entamer une polémique sociale ou polittque !

Il existe des alternatives gratuites à chatGPT, la technologie derrière (les modèles de langage, les réseaux neurones) étant connue et disponible gratuitement, parfois depuis très longtemps :

J’aime assez l’image de « machine à potard » de @mannix54 pour décrire ce qui semblent être les réseaux de neurones.

Mais l’IA, ça peut être un peu plus que ça. Il peut y avoir une partie fonctionnant par apprentissage (via un réseau de neurones ou autre) combinée à d’autres fonctionnant par algorithmie ou par simple recherche de données.

Pour reprendre l’exemple des mathématique, il y a aujourd’hui des « prouveurs » (désolé pour l’anglicisme) qui fonctionnent plutôt bien dans certaines applications. Et en langue, l’utilisation de bases de traductions de phrases a fait faire de sacrés progrès aux traducteurs automatiques.

Et l’on peut aussi envisager que ces systèmes soient ou deviennent auto programmables (qu’ils soient capable de concevoir des algorithmes ou des améliorations de leur fonctionnement qui les rendent plus efficaces).

Comme le faisait dire l’écrivain de SF Asimov à un de ses personnages non sans un certain humour (noir) dans les années 1950, n’est-il pas troublant que l’humanité ait inventé dans le même temps la bombe atomique et l’ordinateur, laissant entendre que nous pourrions n’être que des intermédiaires ayant bientôt fait leur temps vers une forme d’intelligence supérieure… Je passe sur les films qui ont repris ce thème.

Il y a aussi des IA dont le rôle est de générer des photos les plus réalistes possibles,

comme ça utilise des réseaux de neurones alors il y a des erreurs de temps en temps dans les images générées (comme dans les réponses de GPT), ça donne ce genre de bêtisier, avec des femmes qui ont des mains à 7 doigts, ou qui ont 40 dents ![]() :

:

ça illustre le fait que ces IA n’ont pas conscience de ce qu’ils produisent, le résultat produit étant le résultat de paramètres (« les potards », même si c’est un gros raccourci que je fais pour simplifier) fixés une fois pour toute après un long apprentissage sur un jeu de données, c’est censé produire un résultat crédible, mais il y a parfois des erreurs, inévitables à cause du principe du machine learning, tendre vers la perfection sera très difficile (il faudrait « fine-tuner » le modèle à chaque fois qu’on découvre une erreur de prédiction), le même problème se pose aussi pour la génération de texte (chatGPT).

Doctsf (Modèles & Marques)

Doctsf (Modèles & Marques) Annonces

Annonces